A Google Gemma 4 modellje 31 milliárd paraméterrel érte el a harmadik helyet az Arena AI ranglistán

A Gemma 4 modell 31 milliárd paraméteres verziója mellett a Google három kisebb modellt is kiadott, beleértve a 2B és 4B paraméteres E2B és E4B modelleket is.

Google DeepMind bejelentette a Gemma 4 sorozatot, amely négy új, látásra képes, Apache 2.0 licencű LLM‑t tartalmaz: 2 milliárd, 4 milliárd, 31 milliárd és 26 milliárd-A4B paraméteres modellt. A 31B verzió a világ harmadik legjobb nyílt modellje a Arena AI szövegértési ranglistán.

A kisebb modelleket E2B és E4B néven nevezik, mert a Per‑Layer Embeddings (PLE) technológiával csökkentik a tényleges paraméterszámot, miközben a teljes modellméret 4,41 GB és 6,33 GB. A 26B-A4B modell 17,99 GB, a 31B modell pedig 19,89 GB.

A Gemma 4 a „intelligence‑per‑parameter” terén rekordot állít, és a Google a nagyobb, 31B és 26B‑A4B modellek API-ját kínálja az AI Studio platformon keresztül.

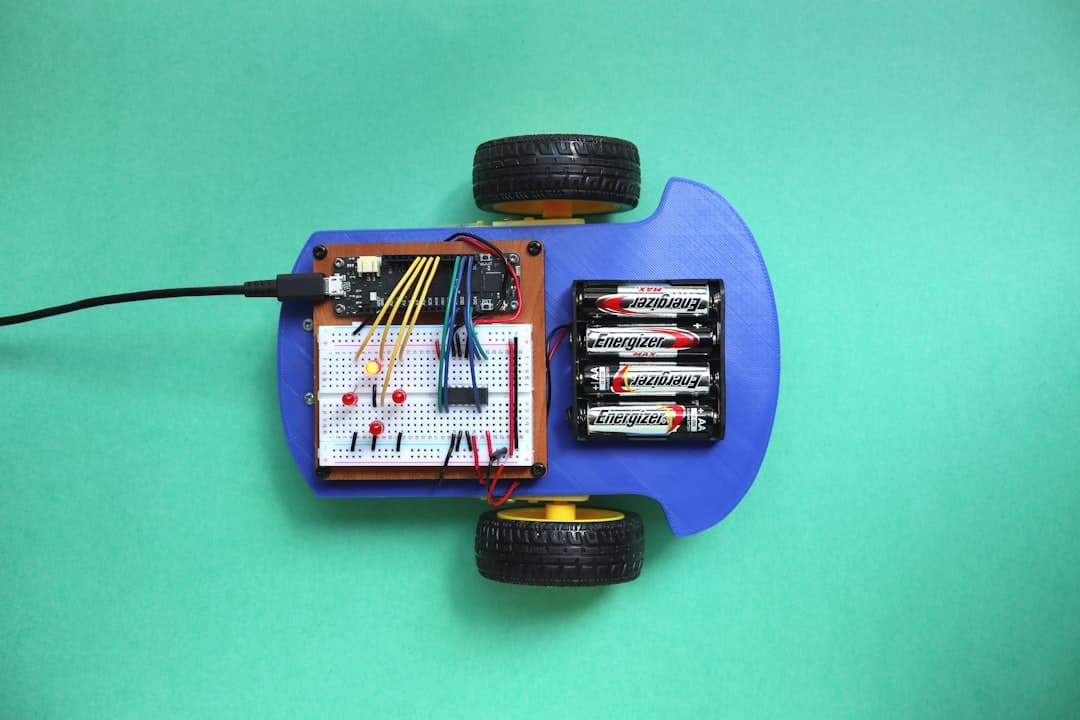

A modellek a legfrissebb vizuális és szöveges feldolgozási feladatokat is támogatják, így a fejlesztők valós idejű, eszközön belüli alkalmazásokat építhetnek, anélkül, hogy jelentős számítási kapacitást igényelnének.

A következő lépés a 31B modell teljesítményének további finomhangolása és a 26B-A4B Mixture‑of‑Experts bevezetése a széleskörű piaci elérhetőséghez.