A memóriahiány fojtogatja az AI-t: A nagy nyelvi modellek sebessége forog kockán

Az AI-adatközpontok memóriachipek iránti „falánk étvágya” miatt az amerikai áramfogyasztás 2028-ra elérheti az országos fogyasztás 12 százalékát.

A nagy nyelvi modellek (LLM-ek) sebességét jelentősen korlátozza a memóriahiány, különösen az úgynevezett nagy sávszélességű memória (HBM) területén – írja az IEEE Spectrum AI. Az AI-adatközpontok „falánk étvágya” a memóriachipek iránt komoly ellátási problémákat okoz.

Az AI-számítástechnika erőforrásigénye soha nem látott mértékű. A generatív AI-lekérdezések 2025-ben 15 terawattórát fogyasztottak, és az előrejelzések szerint 2030-ra elérik a 347 TWh-t. Az AI-adatközpontok hűtéséhez szükséges vízfogyasztás 2028-ra megduplázódhat vagy akár megnégyszereződhet a 2023-as szinthez képest.

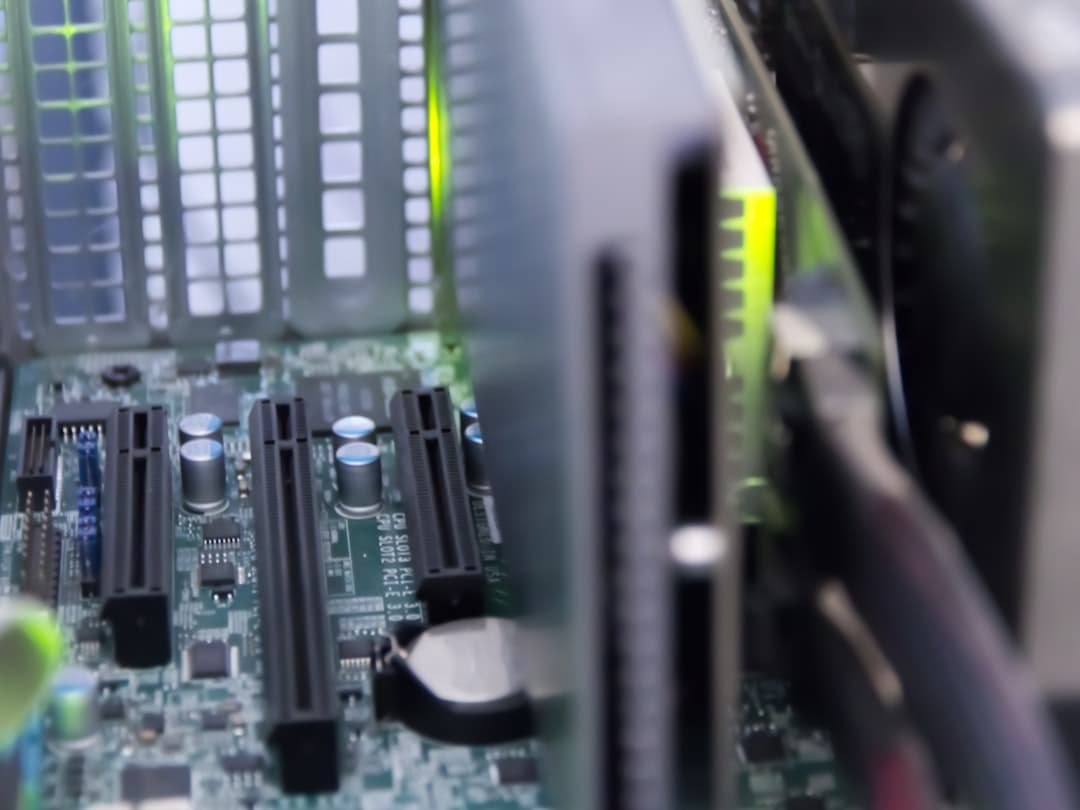

A HBM egy speciális memóriatípus, amelyet kifejezetten AI-processzorokhoz gyártanak. Az olyan chipgyártók, mint a Nvidia és az AMD, egyre több memóriát igényelnek chipjeikhez, válaszul a Google, Microsoft, OpenAI és Anthropic cégek hatalmas adatközpont-fejlesztéseire. Egyes létesítmények kolosszális méretűek, például a Meta 5 gigawattos louisianai Hyperion telephelye.

Samuel K. Moore, az IEEE Spectrum vezető szerkesztője szerint a memóriahiány enyhülésének jele lehet, ha a három nagy HBM-gyártó – a Micron, a Samsung és a SK Hynix – módosítja új gyártási ütemterveit. A keresleti oldalon az is sokatmondó lesz, hogyan alkalmazkodnak a technológiai cégek az ellátási láncban.

Az adatközpontok akár olyan hardverek felé is fordulhatnak, amelyek kevesebb memóriát igényelnek, csekélyebb teljesítmény árán. Az induló vállalatok pedig kreatív újratervezésekkel próbálkozhatnak, hogy csökkentsék a memóriafogyasztást – mondta Moore. Az ilyen korlátok gyakran vezetnek innovatív technológiai megoldásokhoz.